- Seguridad

Alertan por extorsiones a través de inteligencia artificial en Veracruz

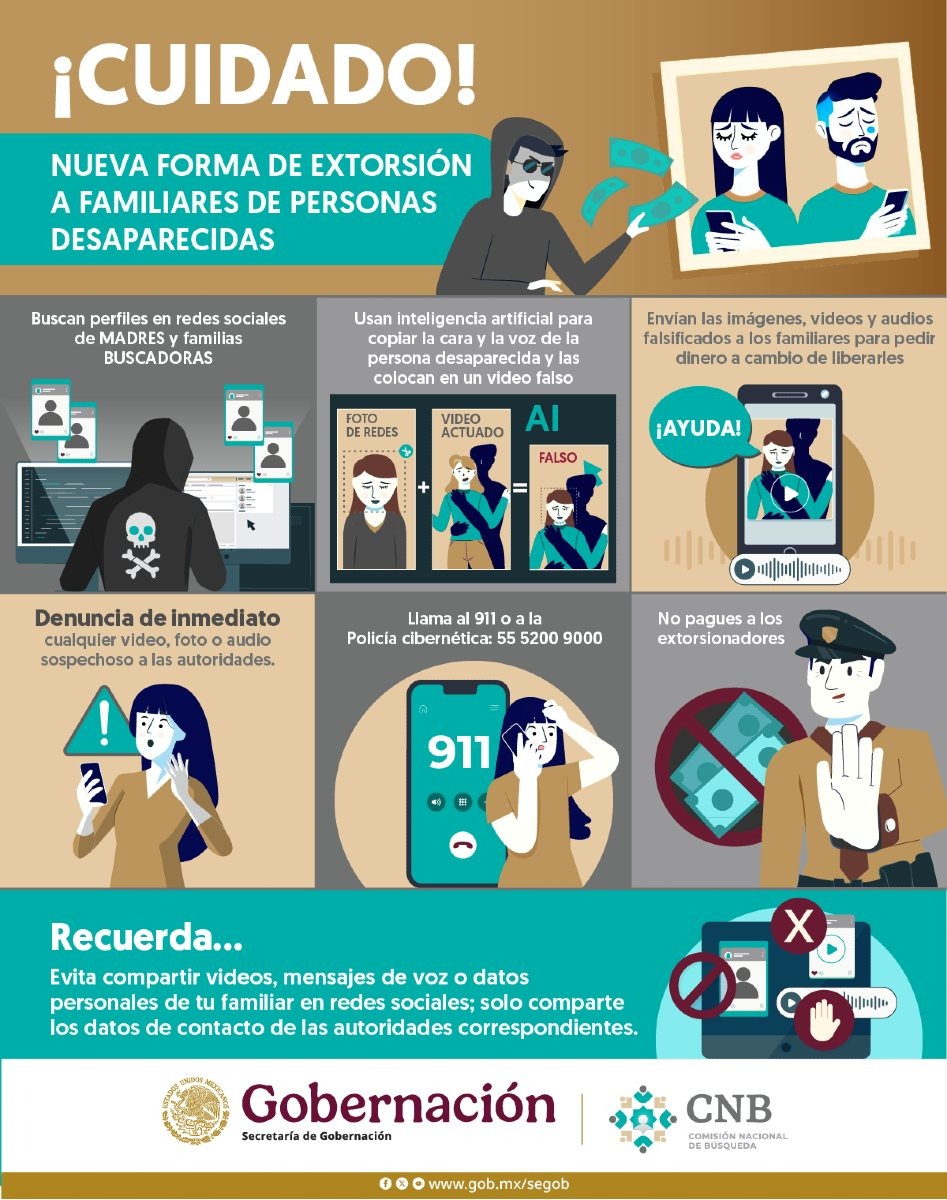

Veracruz, Ver.- La Comisión Nacional de Búsqueda alertó a la ciudadanía en general y a los familiares de personas desaparecidas de todos los estados, incluido Veracruz, que la delincuencia organizada comienza a utilizar la inteligencia artificial para extorsionar.

De acuerdo con la Comisión Nacional de Búsqueda, los delincuentes usan herramientas de la inteligencia artificial para crear materiales de extorsión dirigidos a personas que buscan a algún familiar, por ejemplo, videos o audios falsos.

En estos videos o audios simulan que la personadesaparecida es la que habla es la y, en cuestión de minutos, les pide dinero a las familias a cambio de su liberación.

“¡Atención! Hay una nueva forma de extorsión a familias de personas desaparecidas. Delincuentes crean fotos y videos falsos usando programas de inteligencia artificial para engañar a las familias y exigir pagos”, advirtió la Comisión a travésde un comunicado.

También obtienen información personal de los familiares de las personas desaparecidas a través de redes sociales, por lo que la recomendación es a no compartir información personal de números de contacto que puedan ser aprovechados por la delincuencia para estos fines.

“Evita compartir videos, mensajes de voz o datos personales de tu familiar en redes sociales; solo comparte los datos de contacto de las autoridades correspondientes”, indicó la Comisión.

En caso de que alguna persona reciba un video o un audio donde presuma que es la voz del familiar desaparecido, debe de comunicarse directamente al 911 o denunciarlo a la policía cibernética.

“Denuncia cualquier contenido sospechoso. Llama al 911 o a la Policía Cibernética: 55 5200 9000. Protege la información de tus seres queridos”.

La comisión pidio que no se realice ningún pago que sea exigido por las personas que envían este tipo de mensajes.

En un en una búsqueda rápida a través de Google se pueden observar varias opciones de clonación de voz a través de la inteligencia artificial.

De acuerdo con Factchequeado, iniciativa colaborativa sin fines de lucro periodística que busca combatir la desinformación, rexpresó que ejemplos de estas prácticas se observan en videos de parodia a Donald Trump y Joe Biden y versiones de canciones de Ariana Grande o Lady Gaga.

Factchequeado señala que las voces generadas por software son capaces de imitar el habla, el timbre y la prosodia (elementos como el acento, el tono de la voz, la entonación…) de una persona en concreto.

Destacadas

-

CNTE Veracruz se sumará a huelga nacional por reforma del ISSSTESociedadHace: 1 año 1 semana

CNTE Veracruz se sumará a huelga nacional por reforma del ISSSTESociedadHace: 1 año 1 semana -

Roberto Ramos Alor, nuevo titular de IMSS Bienestar en VeracruzPolíticaHace: 1 año 1 semana

Roberto Ramos Alor, nuevo titular de IMSS Bienestar en VeracruzPolíticaHace: 1 año 1 semana -

El historial negro de Jorge Winckler, exfiscal de VeracruzEstadoHace: 3 años 9 meses

El historial negro de Jorge Winckler, exfiscal de VeracruzEstadoHace: 3 años 9 meses -

Asesinan a hombre en parada de autobús en Lázaro CárdenasSeguridadHace: 6 años 11 meses

Asesinan a hombre en parada de autobús en Lázaro CárdenasSeguridadHace: 6 años 11 meses -

Colectivo Solecito critica desatención de Winckler frente a embajadores de EUVeracruzHace: 6 años 11 meses

Colectivo Solecito critica desatención de Winckler frente a embajadores de EUVeracruzHace: 6 años 11 meses -

Una vez más, invaden caminos del parque El Haya con automóviles de oficinistasXalapaHace: 6 años 11 meses

Una vez más, invaden caminos del parque El Haya con automóviles de oficinistasXalapaHace: 6 años 11 meses -

Se acabó la era Pascual Lagunes, Tamsa lo despideVeracruzHace: 6 años 11 meses

Se acabó la era Pascual Lagunes, Tamsa lo despideVeracruzHace: 6 años 11 meses -

Fidel Kuri presenta a Enrique Meza como nuevo técnico de los Tiburones RojosDeportesHace: 6 años 11 meses

Fidel Kuri presenta a Enrique Meza como nuevo técnico de los Tiburones RojosDeportesHace: 6 años 11 meses